TinyCore Linux è una distribuzione estremamente leggera e minimalista. È progettata per essere il più efficiente possibile in termini di utilizzo di risorse, richiedendo molto poco spazio su disco e memoria, il che la rende particolarmente adatta per l’uso su hardware con specifiche limitate o per utenti che desiderano un sistema molto veloce e reattivo. Le dimensioni dell’immagine ISO di TinyCore sono incredibilmente piccole rispetto alla maggior parte delle distribuzioni Linux, anche leggere: sono infatti nell’ordine dei MB anziché dei GB.

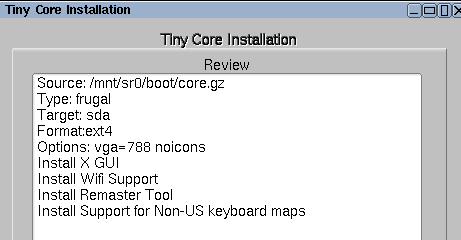

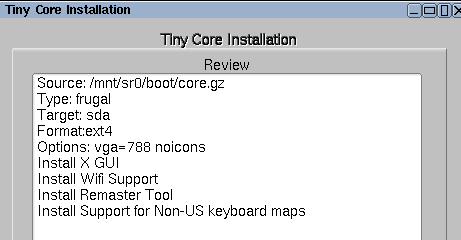

Durante l’installazione potete scegliere i componenti aggiuntivi da integrare nella distribuzione

Tre distribuzioni e tante estensioni

TinyCore fa parte del progetto Core che offre tre diverse distribuzioni. Core ha l’installazione più piccola (17 MB) e include solo l’interfaccia a riga di comando e il minimo indispensabile per avviare il sistema. TinyCore (23 MB) ha integrato invece un ambiente desktop grafico minimale basato su FLTK/FLWM, oltre a una serie di applicazioni di base. C’è poi CorePlus (248 MB), pensata per facilitare l’installazione su vari hardware, che include driver aggiuntivi e strumenti di configurazione, nonché un’opzione per scegliere tra diversi ambienti desktop leggeri. Oltre al sistema di base ci sono poi le estensioni che vi permettono di ampliare la vostra versione. In aggiunta alle versioni x86 di cui parliamo qui, ci sono anche port per dispositivi ARM, inclusa la Raspberry Pi.

Le novità di Tiny Core Linux 15

La versione 15 apporta aggiornamenti significativi pur mantenendo la sua essenza minimalista. Aggiorna il nucleo al kernel 6.6.8, migliorando la compatibilità con l’hardware recente. Incorpora inoltre glibc 2.38, permettendo agli sviluppatori di lavorare con le più recenti librerie C. La distribuzione è anche passata alla versione 13.2 di GCC (GNU Compiler Collection), una suite di compilatori Open Source che supporta vari linguaggi di programmazione, tra cui C, C++, Objective-C, Fortran, Ada, e Go. Questa release ha anche risolto diversi bug e introdotto miglioramenti alle applicazioni principali e alle utilità di sistema.

Tiny Core è un esempio perfetto di ciò che il progetto Core può produrre: un desktop FLTK/FLWM da 23 MB basato su un nucleo e una serie di estensioni costruite dalla comunità

Leggi anche: “La distro leggere basata su slackware“