News

Light Commands: Gli hacker possono violare Alexa , Siri e Google Assistant

Light Commands, un nuovo attacco che consente a un utente malintenzionato di inserire segnali audio arbitrari negli assistenti vocali utilizzando la luce da una lunga distanza.

Ricercatori di sicurezza dell’Università di Electro-Communications e Michigan hanno scoperto che la nuova classe dell’attacco di iniezione soprannominata “Light Commands” è una vulnerabilità nei microfoni MEMS che consente agli aggressori di iniettare comandi impercettibili e invisibili negli assistenti vocali.

I ricercatori hanno identificato una vulnerabilità nel microfono MEMS (sistemi microelettromeccanici), che risponde alla luce se ha un suono, sfruttando quest’ultimo può essere iniettato nei microfoni modulando l’ampiezza della luce laser.

Gli aggressori possono inviare da remoto segnali invisibili e impercettibili a dispositivi domestici intelligenti come Alexa, Portal, Google Assistant o Siri. I sistemi Voice Controller non dispongono di meccanismi di autenticazione, che consentono a un utente malintenzionato di dirottare i dispositivi e possono svolgere le seguenti funzioni.

- Controllo degli interruttori domestici intelligenti

- Aprire le porte del garage.

- Fare acquisti online

- Sbloccare e avviare in remoto determinati veicoli

- Forzare il PIN dell’utente

Per sfruttare l’attacco non è richiesto alcun accesso fisico o interazione dell’utente, tutto ciò che l’attaccante deve avere è l’accesso alla linea di vista al dispositivo bersaglio e alle sue porte del microfono. I ricercatori confermano che l’attacco funziona con 110 metri di lunghezza e hanno pubblicato un documento PDF con i dettagli.

Cybersecurity

Olimpiadi 2024: Wi-Fi pubblico poco sicuro

In occasione dei Giochi Olimpici e Paralimpici estivi, gli esperti di Kaspersky hanno analizzato circa 25.000 Wi-Fi pubblici a Parigi ed è emerso che quasi il 25% di queste reti ha una crittografia debole o assente

In vista delle Olimpiadi di Parigi, Kaspersky ha analizzato la sicurezza delle reti Wi-Fi aperte a cui i visitatori potrebbero collegarsi. Su 47.891 segnali analizzati in luoghi frequentati e sedi olimpiche (le aree di analisi comprendono: Arco di Trionfo, Avenue des Champs-Élysées, Museo del Louvre, Torre Eiffel, Cattedrale di Notre Dame, Senna, Trocadéro, Stadio di Francia), sono stati identificati 24.766 punti di accesso Wi-Fi unici. Un quarto di queste reti presenta gravi carenze di sicurezza, come crittografia debole o inesistente, rendendole vulnerabili agli attacchi. Inoltre, quasi il 20% delle reti usa WPS, un algoritmo obsoleto e facilmente compromettibile. Solo il 6% delle reti adotta il protocollo di sicurezza WPA3.

I criminali informatici potrebbero sfruttare queste reti per rubare dati sensibili degli utenti. Kaspersky consiglia di utilizzare una VPN, come Kaspersky VPN Secure Connection per criptare la connessione e proteggere i dati personali e finanziari su reti Wi-Fi pubbliche.

Per avere maggiori informazioni sulla sicurezza della rete Wi-Fi di Parigi, consigliamo di visitare il sito Kaspersky Daily

Quando si utilizza il Wi-Fi pubblico, gli esperti consigliano sempre di seguire alcune regole comportamentali:

- Evitare le transazioni sensibili: non accedere a conti bancari o ad altri servizi sensibili quando si utilizza il Wi-Fi pubblico.

- Verificare la rete: assicurarsi che sia legittima verificando con la struttura che la mette a disposizione.

- Attivare i firewall: controllare che il firewall del dispositivo sia attivo per bloccare gli accessi non autorizzati.

- Utilizzare password forti: impostare sempre password efficaci e uniche e attivare l’autenticazione a due fattori per una maggiore protezione.

- Aggiornare i software: eseguire regolarmente l’aggiornamento del sistema operativo, delle applicazioni e del software antivirus per proteggersi dalle minacce più recenti.

- Disattivare la condivisione dei file: per evitare accessi non autorizzati, disabilitare la condivisione di file e AirDrop sul dispositivo.

leggi anche: “Fan dei gliochi olimpici truffati”

*illustrazione articolo progettata da Freepik

News

Guasto informatico a Microsoft

Dopo una giornata di disagi globali, l’azienda di sicurezza informatica CrowdStrike ha risolto il bug causato da un suo aggiornamento

L’Italia è stata colpita da una grave crisi informatica causata da un crash dei sistemi Windows, dovuto a un software di cybersecurity della Crowdstrike, azienda che produce la suite di sicurezza Falcon.

Il problema è stato causato da un file difettoso nella comunicazione tra l’agente Falcon e la piattaforma cloud, portando al blocco totale dei sistemi Windows, il cosiddetto Blue Screen of Death.

Ecco la soluzione temporanea suggerita da Crowdstrike: avviare Windows in modalità provvisoria, accedere alla cartella C:\Windows\System32\drivers\CrowdStrike ed eliminare il file difettoso C-00000291*.sys

Questo incidente ha avuto un impatto significativo su aziende europee e americane, con un calo del 20% nel valore delle azioni di Crowdstrike. Microsoft, sebbene inizialmente accusata, è risultata essere vittima del problema, che ha colpito duramente anche la sua infrastruttura cloud Azure. Il CEO di Crowdstrike ha rassicurato che i sistemi Mac e Linux non sono stati coinvolti. La risoluzione del problema sta procedendo rapidamente, ma il ripristino completo richiederà tempo dato il gran numero di server colpiti.

News

Fan dei Giochi Olimpici truffati

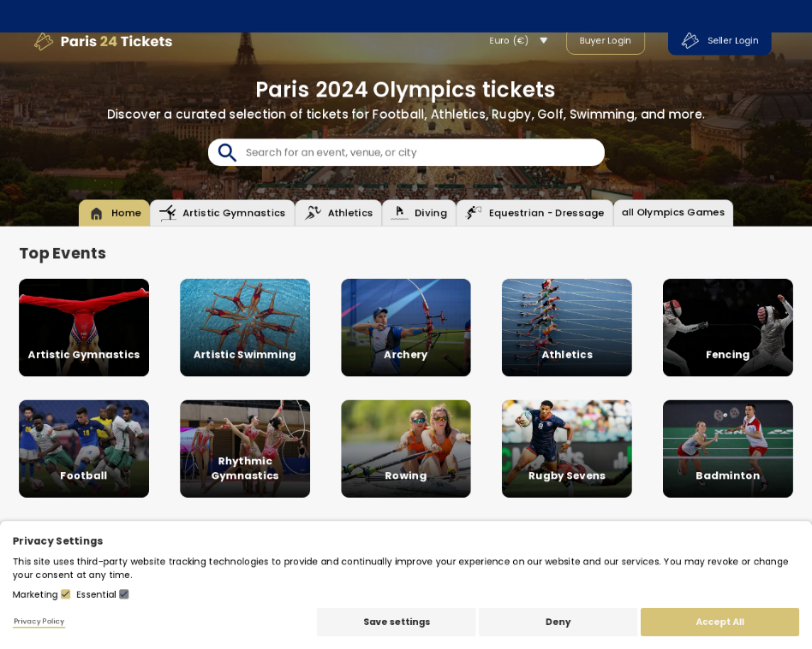

In vista delle prossime Olimpiadi Estive, che inizieranno il 26 luglio, si sono registrate una impennata delle attività di scamming legate all’evento, con truffatori che mirano a denaro e dati degli utenti. Kaspersky ha analizzato i siti Web di phishing legati alle Olimpiadi identificando i principali schemi attualmente in uso

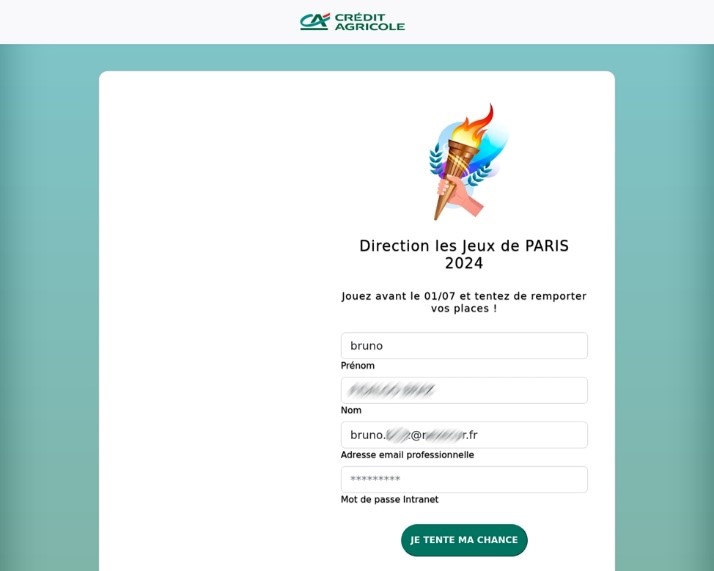

Gli esperti di Kaspersky hanno rilevato un aumento delle attività di scamming legate alle Olimpiadi di Parigi 2024. Dopo l’allarme del Comitato Olimpico sulle offerte di biglietti falsi e la truffa subita dalla famiglia di un nuotatore britannico, sono emersi numerosi siti Web di phishing. Questi siti offrono biglietti per eventi olimpici a prezzi vantaggiosi o per gare sold-out, ingannando gli utenti a fornire dati personali e denaro. Spesso le vittime non ricevono nulla o biglietti falsi, e i loro dati vengono venduti nel Dark Web. Inoltre, sono stati scoperti falsi premi aziendali che inducono i dipendenti a fornire credenziali di login, e store online fraudolenti che vendono articoli di merchandising senza mai consegnarli. Un’altra truffa comune è quella dei pacchetti dati gratuiti per telefoni mobili, che richiedono informazioni personali e dettagli di pagamento, utilizzati poi per scopi malevoli.

Un esempio di pagina di phishing che offre biglietti per le Olimpiadi

“Durante eventi importanti come le Olimpiadi, la quantità di offerte può essere enorme e molto rischiosa”, ha affermato Anton Yatsenko, Cybersecurity Expert di Kaspersky. “I truffatori sfruttano l’entusiasmo delle persone, per cui è fondamentale considerare ogni offerta con una sana dose di scetticismo. Bisogna ricordare che se una cosa sembra troppo bella per essere vera, probabilmente lo è. Prendetevi il tempo necessario per verificare l’autenticità delle offerte e proteggere i vostri dati personali. La vostra attenzione può fare la differenza tra godersi l’evento ed essere vittima di una truffa”.

Un esempio di pagina di phishing che propone biglietti per le Olimpiadi

Per evitare le truffe durante le Olimpiadi, gli esperti di Kaspersky hanno condiviso alcuni consigli:

- Verificare l’autenticità: acquistare biglietti, prodotti o servizi solo da fonti autorizzate e affidabili. Controllare il sito web ufficiale dell’evento per individuare i venditori abilitati.

- Essere scettici sulle offerte: se un’offerta sembra troppo bella per essere vera, è probabile che lo sia. Bisogna essere cauti nei confronti di sconti elevati e offerte esclusive, soprattutto se provengono da fonti sconosciute.

- Proteggere i propri dati: evitare di condividere informazioni personali e finanziarie su siti web sconosciuti. Assicurarsi che il sito sia sicuro verificando che sia presente “https” nell’URL e il simbolo del lucchetto nella barra del browser.

- Utilizzare software di sicurezza: aggiornare il software antivirus e di sicurezza per evitare malware e attacchi di phishing.

- Essere aggiornati: rimanere informati sulle tattiche di truffa più comuni e su come riconoscerle. Seguire gli ultimi aggiornamenti forniti da esperti di cybersecurity e da fonti ufficiali.

*illustrazione articolo progettata da Freepik

News

Vulnerabilità critica in OpenSSH

Scoperta dai ricercatori Akamai, questa falla potrebbe consentire l’esecuzione di codice remoto non autenticato.

I ricercatori di Akamai hanno esaminato la vulnerabilità critica in OpenSSH (CVE-2024-6387), nota come regreSSHion, scoperta dal Qualys Threat Research Unit. Questa vulnerabilità potrebbe consentire l’esecuzione di codice remoto non autenticato ed è derivata da una regressione della vecchia vulnerabilità CVE-2006-5051. La vulnerabilità è stata resa pubblica il 1° luglio 2024.

La causa è una race condition legata alla gestione non sicura dei segnali durante un timeout nell’autenticazione dell’utente, che può portare all’esecuzione di codice arbitrario. Le versioni di OpenSSH colpite sono quelle precedenti alla 4.4/4.4p1 (se non patchate), introdotte di nuovo in OpenSSH 8.5/8.5p1, e risolte nella versione 9.8/9.8p1.

L’impatto è significativo, colpendo molte distribuzioni Linux, ma diversi fattori riducono il rischio immediato, tra cui limitazioni della PoC, complessità dello sfruttamento su architetture amd64 e necessità di connessioni multiple per un attacco riuscito. Per mitigare la vulnerabilità, è consigliato aggiornare OpenSSH a una versione non vulnerabile, utilizzare query Osquery per rilevare asset vulnerabili, e segmentare le interfacce SSH esposte a internet. Se le patch tardano, aumentare la sensibilità degli allarmi sui workload vulnerabili e monitorare i tentativi di brute-force.

Il blog di Akamai fornisce una panoramica della vulnerabilità, con dettagli tecnici, versioni affette, impatto e strategie di mitigazione, oltre a una query Osquery per rilevare le versioni vulnerabili. Akamai continuerà a monitorare queste e altre minacce e fornirà ulteriori informazioni non appena si presenteranno. Aggiornamenti in tempo reale su ulteriori ricerche sono disponibili sul canale Twitter di Akamai.

News

Tiny Core: la distro delle tre sorelle

Tre versioni per un sistema operativo che fa delle dimensioni ridottissime, della velocità e della personalizzabilità i suoi punti di forza

TinyCore Linux è una distribuzione estremamente leggera e minimalista. È progettata per essere il più efficiente possibile in termini di utilizzo di risorse, richiedendo molto poco spazio su disco e memoria, il che la rende particolarmente adatta per l’uso su hardware con specifiche limitate o per utenti che desiderano un sistema molto veloce e reattivo. Le dimensioni dell’immagine ISO di TinyCore sono incredibilmente piccole rispetto alla maggior parte delle distribuzioni Linux, anche leggere: sono infatti nell’ordine dei MB anziché dei GB.

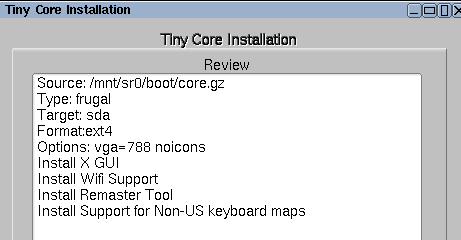

Durante l’installazione potete scegliere i componenti aggiuntivi da integrare nella distribuzione

Tre distribuzioni e tante estensioni

TinyCore fa parte del progetto Core che offre tre diverse distribuzioni. Core ha l’installazione più piccola (17 MB) e include solo l’interfaccia a riga di comando e il minimo indispensabile per avviare il sistema. TinyCore (23 MB) ha integrato invece un ambiente desktop grafico minimale basato su FLTK/FLWM, oltre a una serie di applicazioni di base. C’è poi CorePlus (248 MB), pensata per facilitare l’installazione su vari hardware, che include driver aggiuntivi e strumenti di configurazione, nonché un’opzione per scegliere tra diversi ambienti desktop leggeri. Oltre al sistema di base ci sono poi le estensioni che vi permettono di ampliare la vostra versione. In aggiunta alle versioni x86 di cui parliamo qui, ci sono anche port per dispositivi ARM, inclusa la Raspberry Pi.

Le novità di Tiny Core Linux 15

La versione 15 apporta aggiornamenti significativi pur mantenendo la sua essenza minimalista. Aggiorna il nucleo al kernel 6.6.8, migliorando la compatibilità con l’hardware recente. Incorpora inoltre glibc 2.38, permettendo agli sviluppatori di lavorare con le più recenti librerie C. La distribuzione è anche passata alla versione 13.2 di GCC (GNU Compiler Collection), una suite di compilatori Open Source che supporta vari linguaggi di programmazione, tra cui C, C++, Objective-C, Fortran, Ada, e Go. Questa release ha anche risolto diversi bug e introdotto miglioramenti alle applicazioni principali e alle utilità di sistema.

Tiny Core è un esempio perfetto di ciò che il progetto Core può produrre: un desktop FLTK/FLWM da 23 MB basato su un nucleo e una serie di estensioni costruite dalla comunità

Leggi anche: “La distro leggere basata su slackware“

News

Attacchi Trojan in aumento

In forte crescita le violazioni informatiche alle PMI a causa della ricomparsa di attacchi basati su Microsoft Excel

In occasione della Giornata Internazionale delle PMI che si è svolta lo scorso 27 giugno, un report di Kaspersky ha rivelato un aumento del 5% nelle infezioni informatiche nel settore delle PMI nel primo trimestre del 2024 rispetto allo stesso periodo del 2023. In particolare, 2.402 utenti hanno incontrato malware e software indesiderati che imitano prodotti software, con 4.110 file unici distribuiti sotto forma di software per PMI, segnando un incremento dell’8% rispetto all’anno precedente. Il report sottolinea che le PMI sono sempre più spesso bersagliate dai criminali informatici, con i Trojan come forma di attacco più diffusa. I Trojan sono particolarmente pericolosi poiché imitano software legittimi e riescono a eludere le misure di sicurezza tradizionali. Da gennaio ad aprile 2024, Kaspersky ha registrato 100.465 attacchi Trojan, un aumento del 7% rispetto allo stesso periodo del 2023.

Microsoft Excel è diventato il principale canale di attacco, seguito da Microsoft Word, mentre Microsoft PowerPoint e Salesforce sono state le terze applicazioni più colpite.

News

Difendersi dai bot di web scraping

I bot costituiscono il 42% del traffico web complessivo e quasi i due terzi sono dannosi, in particolare per l’e-commerce

Akamai Technologies ha pubblicato un nuovo State of Internet Report (SOTI) che analizza le minacce derivanti dalla proliferazione dei bot di web scraping. Il report, intitolato “Gestire i profitti: l’impatto dei Web Scrapers sull’ecommerce”, rivela che il 42% del traffico web è generato da bot, e il 65% di questi è dannoso. Il settore e-commerce è il più colpito da questi bot, utilizzati per attività come spionaggio della concorrenza, creazione di siti falsi e attacchi che danneggiano il fatturato e l’esperienza dei clienti.

Nonostante l’assenza di leggi che vietino l’uso dei bot scraper e la difficoltà di rilevarli, le aziende possono adottare strategie di mitigazione. Patrick Sullivan di Akamai sottolinea che i bot rappresentano una sfida significativa, in grado di sottrarre dati e replicare siti web. Il report evidenzia l’uso di botnet basate su AI per il furto di dati, la creazione di campagne di phishing sofisticate e la facilità di creare nuovi account fraudolenti, che costituiscono fino al 50% delle perdite per frode.

I bot scraper peggiorano le performance dei siti web, manipolano le metriche, e aumentano i costi di elaborazione. Il report offre strategie di difesa e un caso di studio su come migliorare l’efficacia dei siti web attraverso la mitigazione dei bot scraper. Questo report celebra il 10° anniversario della serie SOTI di Akamai, fornendo approfondimenti sulla cybersicurezza e le prestazioni web basati sui dati dell’Akamai Connected Cloud.

*illustrazione articolo progettata da Freepik

-

News3 anni ago

News3 anni agoHacker Journal 278

-

News7 anni ago

News7 anni agoAbbonati ad Hacker Journal!

-

Articoli2 anni ago

Articoli2 anni agoParrot Security OS: Linux all’italiana- La distro superblindata

-

Articoli3 anni ago

Articoli3 anni agoGuida: Come accedere al Dark Web in modo Anonimo

-

Articoli6 anni ago

Articoli6 anni agoSuperare i firewall

-

News4 anni ago

News4 anni agoLe migliori Hacker Girl di tutto il mondo

-

Articoli5 anni ago

Articoli5 anni agoCome Scoprire password Wi-Fi con il nuovo attacco su WPA / WPA2

-

News7 anni ago

News7 anni agoAccademia Hacker Journal